Dlaczego platformy cyfrowe są jak dilerzy?

Internet potrzebuje lepszych modeli biznesowych, a nie więcej cenzury.

– Jakbyś potrzebował jakiegoś info o ludziach z uczelni, daj znać. Człowieku, mam 4 tysiące e-mali, zdjęć, adresów…

– Co? Jak to zrobiłeś?

– Ludzie sami je wpisują. Nie wiem czemu. „Ufają mi”. Debile

Mark Zuckerberg, 19 lat, po założeniu strony „TheFacebook” na kampusie Harvardu w 2004 roku1.

I.

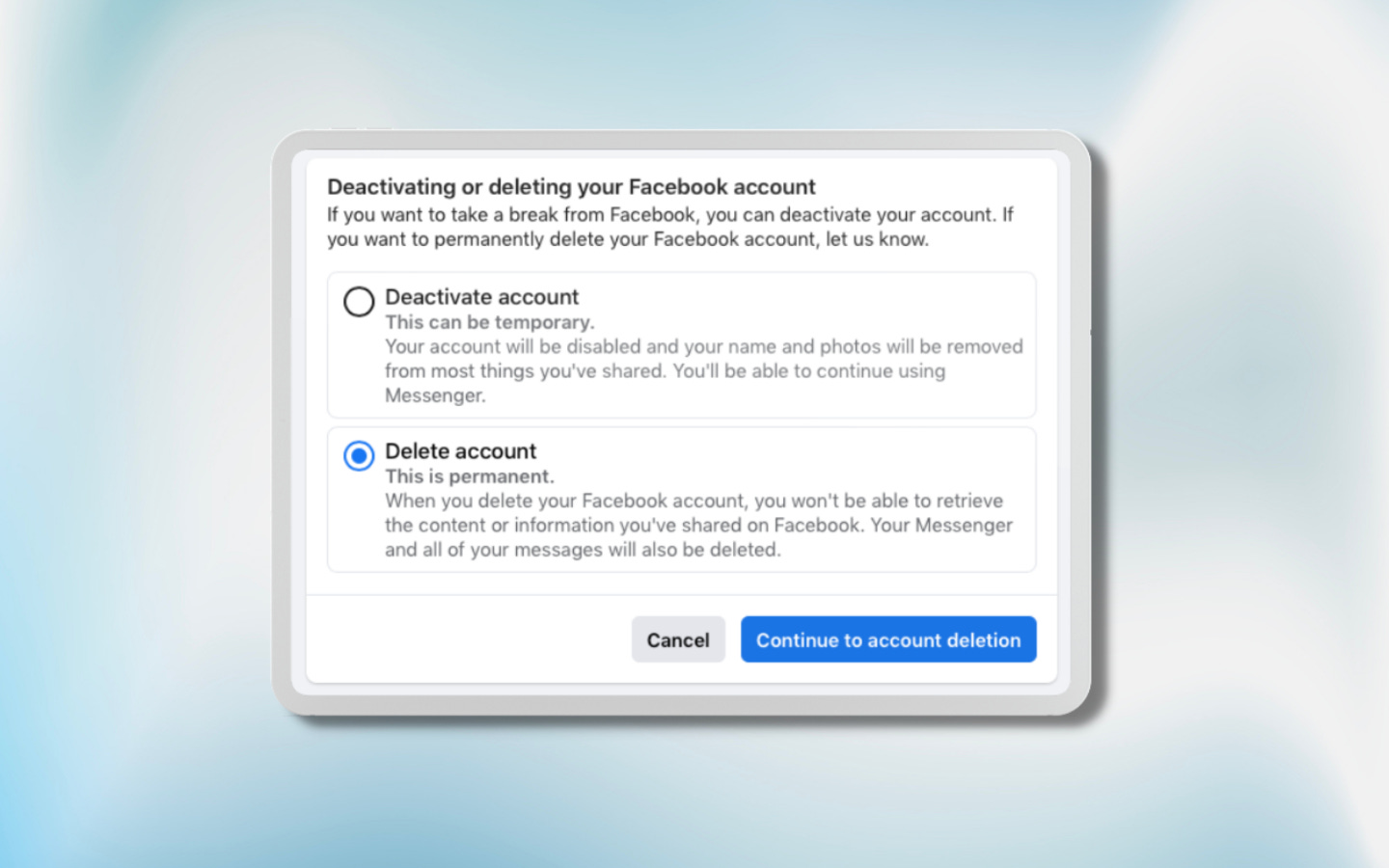

Gdy miesiąc temu skasowałem swoje konto na Facebooku, otrzymałem niejedną wiadomość z gratulacjami odwagi. To miłe. Ale też – powiedzmy sobie uczciwie – dość niecodzienne. Czy gratulujemy człowiekowi, który heroicznie ogłosił, że nie będzie ubierał się w H&M, stanowczo nie zje już Burgera Drwala albo w geście wielkiej brawury odmówi kupna pary butów Nike? Jasne, że nie. Ale sam fakt, że odcięcie się od jednej platformy cyfrowej jesteśmy skłonni uznać za akt cywilnej odwagi albo obywatelskiego nieposłuszeństwa, świetnie pokazuje, czym tak naprawdę stały się korporacje w rodzaju Facebooka, Google i Amazona.

Gratulujemy, życzymy powodzenia i wytrwałości ludziom, którzy odstawili alkohol, papierosy, narkotyki lub inne używki. Wielkie platformy cyfrowe są zaś dilerami – i to nie metafora. Dostarczają nam hormonalnego haju, od którego trudno się uwolnić i całkiem dosłownie wchodzi nam w krew. „Towar”, jakim dilują, to podniesione tętno, rozszerzone źrenice i przyjemny jak zaciągnięcie się porannym papierosem lub łyk zimnego piwa kop, którego dostajemy dzięki lajkom i reakcjom. Czy wiedzieliście, że czerwone ikonki powiadomień specjalnie wymyślono w ten sposób, by pobudzały i zachęcały do sięgnięcia po więcej (czerwony kolor to też, obok wielu innych, znak rozpoznawczy McDonald’s i Marlboro)? To już wiecie.

Developerzy, wspierani przez świetnie wynagradzanych behawiorystów i specjalistów od interfejsów latami pracowali nad tym, by ekran platformy społecznościowej bombardował nas bodźcami i wciągał głębiej (znamy nawet ich nazwiska i jesteśmy w stanie prześledzić historię tych wynalazków). By trudno było wyjść po tym, jak się wejdzie. Podobnie jak w przypadku uzależniającej substancji, prawie nigdy nie udaje nam się zalogować na platformę społecznościową – Facebooka, Instagrama, YouTube’a, Twittera, TikToka… – po jedną dawkę. Architektura tych serwisów jest zaprojektowana tak, aby było to możliwie jak najtrudniejsze. I rzeczywiście, próba wejścia na social-media „tylko, żeby coś sprawdzić” często kończy się dokładnie tak samo, jak obietnica wyjścia „na jedno piwo” w weekend albo wypalenia „tego jednego, ostatniego” papierosa. Podobieństw jest zresztą więcej.

Ale poza tym, że platformy cyfrowe działają jak dilerzy, mają jeszcze inne – być może nawet groźniejsze w skutkach – ambicje. Chcą być czymś w rodzaju krytycznej infrastruktury – wodociągów, linii elektrycznych, dróg i banków centralnych internetu. Inwestorzy w Dolinie Krzemowej budzą się i zasypiają z jedną myślą – żeby ich firmy stały się równie niezbędne do życia jak woda w kranie i energia elektryczna w gniazdku. Ambicją każdej z dużej platform jest stać się pośrednikiem w możliwie największej liczbie codziennych czynności. Słowem: byśmy nie mogli zamówić taksówki, umówić się na randkę, zalogować się do ulubionej strony, odbyć rozmowy z przyjaciółmi, kupić książki lub nowego kompletu pościeli, wziąć kredytu lub wymienić waluty, uwiarygodnić swojego wieku i tożsamości bez dostarczania im swoich danych. Nawet rozprawy w sądach on-line w Polsce prowadzi się przez platformę amerykańskiej firmy – słowem, nie mogę uzyskać gwarantowanego mi przez konstytucję dostępu do wymiaru sprawiedliwości, o ile nie zaakceptuję regulaminu Microsoft. Narzędzia do śledzenia zachorowań na COVID w wielu państwa opierają się na rozwiązaniach dostarczanych przez te same firmy, a dowody tożsamości i głosowanie są następne w kolejce… Tak, kilka lat temu było to przedmiotem literatury science-fiction. Żyjemy w cyberpunku, ale to nie rozświetlone neonami Tokio i „Blade Runner 2049”, tylko rynek w Koluszkach w listopadzie.

Z używek trudno nam zrezygnować, bo domaga się ich nasz mózg i ciało. Wyjście z nałogu bywa bardzo trudne. Zrezygnowanie z usług podstawowych, z krytycznej infrastruktury, jest po prostu niemożliwe. Nawet ci nieliczni dogmatyczni libertarianie i anarchiści, którzy chcieliby wyzwolić się spod dyktatu państwa, gospodarki opartej na pieniądzu albo podatków, wiedzą, że to projekt graniczący z niemożliwością. Ambicją Facebooka (dziś Mety), Google czy Amazona jest to, by nie dało się korzystać z sieci bez nich, tak jak nie da się mieszkać w centrum dużego miasta i bojkotować energię elektryczną, dowody osobiste, drogi i pieniądze.

I to nie jest moja opinia. Mark Zuckerberg – według amerykańskiej dziennikarki Kary Swisher – powiedział jej, że Facebook jest utility, czyli infrastrukturą krytyczną, już podczas ich pierwszej rozmowy ponad 10 lat temu. Gdy Swisher wróciła do tego w wywiadzie w 2018 roku, szef Facebooka się tego nie wyparł.

Może jednak coś z tym obywatelskim nieposłuszeństwem jest coraz bardziej na rzeczy?

II.

Niedawne wycieki dokumentów z Facebooka, ujawnione mediom przez pracującą wcześniej dla firmy Frances Haugen, zwróciły uwagę opinii publicznej na tuzin problemów. Wśród nich specjalne przywileje dla celebrytów i polityków, którym pozwala się szerzyć dezinformację, szkodliwy wpływ algorytmów na samoocenę nastolatek i pogłębianie się politycznej polaryzacji. Amerykańskie media szczególnie mocno skupiły się na tym, jak algorytm Facebooka i grupy tworzone na platformie Zuckerberga podbijały teorie spiskowe, niewiarę w oficjalny wynik wyborów i kult QAnon – co zdaniem wielu ekspertów i niezależnych mediów doprowadziło do ataku demonstrantów na Kapitol 6 stycznia. „Historia nie będzie dla nas łaskawa” – cytuje jedną z wiadomości z wewnętrznej listy dyskusyjnej Facebooka magazyn „The Atlantic”. Niektórzy z pracowników firmy, którzy oglądali na żywo zdarzenia z Waszyngtonu, wiedzieli że nie mają czystego sumienia.

Jednak morał, jaki dziś wyciągamy z wycieków Haugen i „Facebook Papers” może być mylący. Jasne, mamy uzasadnione powody, żeby wkurzać się na teorie spiskowe, niszczenie debaty publicznej i polityczną radykalizację. W niektórych przypadkach, jak w Birmie/Mjanmie media społecznościowe realnie dołożyły się już do czystek etnicznych. Więc jest się czego bać. Ale z każdym kolejnym skandalem dotyczącym dezinformacji, fake newsów i teorii spiskowych, które mnożą się w mediach społecznościowych, do głosu dochodzi przekonanie, że odpowiedzią na te wszystkie bolączki jest jeszcze lepsza moderacja treści, więcej banów i ściślejsza kontrola bezpieczeństwa użytkowników i użytkowniczek.

To nie takie proste.

Problem dezinformacji, polaryzacji, toksycznych treści, teorii spiskowych i baniek informacyjnych nie zniknie, gdy wyrzucimy z platform cyfrowych wszystkich „szurów"i hejterów. Ani gdy dowolna jedna lub każda z tych platform – YouTube, Facebook, Instagram i TikTok – podwoi albo potroi liczbę moderatorów na całym świecie. Likwidowanie teorii spiskowych i dezinformacji na platformach, które są wprost stworzone do ich szerzenia i zarabiania na nich, to wyścig muła z Teslą. A przy okazji zaostrzanie kontroli treści to też świetny sposób na stworzenie jeszcze ciaśniejszych informacyjnych monopoli i oddanie kompletnej kontroli nad debatą publiczną algorytmom.

Problem ze współczesnymi platformami nie polega na tym, że ktoś pisze głupie rzeczy albo wierzy w teorie spiskowe. Zaś próba stworzenia reżimu, w którym każde słowo i teoria podlega zewnętrznej kontroli, to początek technologicznej dystopii.

Nie chodzi tylko o to, że te platformy nie usuwają i nie blokują szkodliwych i naukowych treści wystarczająco szybko (choć to oczywiście również problem). Chodzi o to, że ich model biznesowy wynagradza tworzenie kontrowersji i podziałów – im dłużej ktoś będzie siedział na Facebooku czy YouTube, tym więcej reklam po drodze obejrzy, tym lepiej dla zysków. W sytuacji, w której zdecydowana większość mediów i dziennikarzy powtarza o COVID-19 i szczepionkach to samo, wąskie grono tych influencerów, którzy pójdą wbrew wszystkim oficjalnym narracjom przyciąga nieproporcjonalnie dużo uwagi. Więc są za to wynagradzani. Gdy zdobędą uwagę (i gratyfikację w postaci lajków, udostępnień, obejrzeń i pieniędzy), mają tym większą motywację, by dalej iść tą drogą – tylko jeszcze bardziej kontrowersyjnie i radykalnie. Jedna teoria i szokująca wiadomość musi gonić następną, by publiczność dalej klikała. Im więcej ludzi to ogląda, tym większy zasięg i pokusa, by uderzać jeszcze mocniej. Pętla się zamyka.

Powtórzmy to jeszcze raz: w jakimś sensie to nie twórcy dezinformacji zainfekowali media społecznościowe, ale to media społecznościowe stworzyły twórców dezinformacji i dały im do ręki gotowy mechanizm zarabiania na ogłupianiu ludzi, którzy to mechanizm influencerzy skutecznie wykorzystują.

– pisałem w kontekście pandemii. Ale ten mechanizm działa w odniesieniu do wszystkich innych treści, nie tylko szczepionkowej dezinformacji, ale w odniesieniu do polityki, sportu, feminizmu, rapu i gier wideo. Algorytm w każdej domenie będzie pchał ku radykalizmowi, skandalowi i kontrowersjom.

Potrzebujemy platform, które mają zdrowszy i bardziej przejrzysty model dostarczania treści. Nie takich, które wciągają nas w spirale oburzenia i wściekłego klikania w kontent, który algorytm podsuwa nam, by wyciągnąć z nas jak najwięcej danych. Gdy nie płacimy za treści na platformach cyfrowych gotówką, płacimy swoją prywatnością. Emocje powodują zaś, że nie jesteśmy w stanie się wylogować. Bezalternatywność wielkich platform – to że tam po prostu z powodów zawodowych czy rodzinnych „musimy być” – skutkuje tym, że czasami nawet nie mamy takiej możliwości, żeby z nich zrezygnować. To trzy filary tego toksycznego uzależnienia.

Co ciekawe – nie było tak zawsze, a w sieci istniały i istnieją dochodowe przedsięwzięcia, które opierają się na innej logice. Przekonanie, że każda usługa internetowa musi wysysać z nas dane i po drodze uzależniać, to wciąż krótszy etap historii rozwoju sieci www i usług on-line. Nie było tak zawsze. Tak naprawdę to przede wszystkim dzięki Zuckerbergowi i sukcesowi Facebooka w poprzedniej dekadzie kapitalizm inwigilacji stał się tak popularny.

Ale model nie ma nic wspólnego ani z „wolnym rynkiem idei", ani również internetem 2.0, który fetowaliśmy u zarania epoki mediów społecznościowych. Zamiast samemu wybierać twórców, tytuły i treści, a następnie własnym portfelem i czasem wspierać te, które uznajemy za wartościowe, to nasza uwaga i emocje sprzedawane są tym, którzy dadzą za nie najwięcej. Tak działają wielkie platformy cyfrowe, a za nimi coraz więcej innych usług. Ale można inaczej.

III.

Jeśli czytają państwo ten tekst na Substacku – nasza biznesowa relacja jest prosta. Znalazło się dość osób chętnych zapłacić za moje pisanie, by ten tekst powstał. Jeśli będzie beznadziejny, pewnie stracę kilku subskrybentów, a więc i pieniądze. Jeśli będzie super, niewykluczone że kilkoro zyskam. W dowolnej chwili każda z tych osób może wypisać się mojej listy newsletterowej, a ja nie przechowuję żadnych powiązanych z nimi informacji osobistych – numeru karty płatniczej, lajków i serduszek pozostawionych na mojej stronie, geolokalizacji, nic z tych rzeczy. Platforma, dzięki której dostajecie państwo te teksty, pobiera ode mnie prowizję i z tego zarabia. Twórcy najpopularniejszych newsletterów na substacku zarabiają najwięcej, ale o popularności treści nie decyduje algorytm, tylko sami czytelnicy i czytelniczki. Nie ma mechanizmu, który mówi, że danego dnia „klikają się” newsy o Annie Lewandowskiej, a drugiego o Trumpie, więc muszę pisać o tym, bo inaczej nie zarobię. Nie ma też presji reklamodawców, by zaniżać zasięgi jednym tematom, a podbijać drugim. Wreszcie też, nie ma żadnego „news feedu”, w którym wartościowy tekst o rywalizacji Chin i USA albo reportaż o zapaści służby zdrowia natychmiast zostanie przykryty przez kolejną idiotyczną kłótnię albo mikroskandal, o którym wszyscy zapomną.

Czy to jest model idealny, pozbawiony wad i odporny na wszelkie nadużycia? Oczywiście, że nie. Ale ma pewną nieocenioną zaletę: jest przejrzysty i zrozumiały. Twórcy dość dobrze wiedzą, co dają i co zyskują, podobnie odbiorczynie i odbiorcy mają świadomość tego, za co płacą. Dla odmiany, docieranie do odbiorców na Facebooku i Youtube stało się tak skomplikowanym procesem, a rozgryzienie wszystkich zachcianek i kaprysów algorytmu tak trudne, że istnieją całe wyspecjalizowane agencje zajmujące się tylko tym. Trzeba do nich przyjść i zapłacić pieniądze (albo podzielić się ewentualnym zyskiem), potem jeszcze raz zapłacić Facebookowi albo Instagramowi za reklamy i sponsorowane treści, potem liczyć na przychylność algorytmu lub oszukanie jego ciasnego sita. Nikt nie wie do końca, jak to naprawdę działa. Na pewno nie wiedzą tego zaś końcowi odbiorcy, którzy bombardowani są w efekcie wściekłymi treściami, zaproszeniami do dziwnych grup i większą ilością bezużytecznych informacji niż są w stanie przetrawić. Po drodze oszukiwani są też reklamodawcy, którym wciska się informację o rzekomo wysokich zasięgach i skutecznych kampaniach. Wygrać w tym mogą i tak tylko najsilniejsi, którzy gotowi są za wygenerowany ruch po prostu najwięcej zapłacić – wiedział to dobrze Donald Trump, który wydał na kampanię na Facebooku więcej niż w jakimkolwiek innym medium.

Piszę o substacku, bo podoba mi się jego model (sam go wybrałem), ale i po ponad roku mniej więcej wiem, o czym mówię. Nie wspominam o alternatywnych kanałach społecznościowych i platformach, z których sam nie korzystam. Ale czy komuś podoba się substack, LinkedIn, twitch, discord, Callin, Rumble czy dowolna inna platforma do komunikacji i nawiązywania znajomości, jest w tym momencie drugorzędne. Istotne jest to, że w ogóle istnieją alternatywy i że model podgrzewania oburzenia i wściekłości nie jest jedyny. Nawet jeśli tak do niego przywykliśmy, że póki co dominuje i rządzi cyfrowym życiem miliardów ludzi.

Bo to właśnie w tych modelach i samej konstrukcji platform leży problem. Banowanie pojedynczych użytkowników, polityczna cenzura i polityczna poprawność, wyśrubowane „standardy bezpieczeństwa”, analiza treści przez sztuczną inteligencję…. nic z tego nie uzdrowi naszej debaty, póki nie zmieni się model biznesowy platform cyfrowych. Dilerzy nigdy nie wyleczyli uzależnionych oferując lepszy towar. To tak nie działa.

Internet potrzebuje nowych i lepszych modeli biznesowych, nie więcej cenzury.

Wiadomości wypłynęły w 2010 roku. Zuckerberg potwierdził ich autentyczność w rozmowie z New Yorkerem trzy lata później.